一项新研究发现,在一个暗网论坛上,数千张人工智能生成的虐待儿童的图片被分享。

9月份,论坛上分享了大约3000张虐待儿童的人工智能图像,其中564张描绘了最严重的图像,包括强奸、性虐待和兽交。

根据互联网观察基金会(IWF)的研究,在这些图片中,有1372张描绘的是7到10岁的儿童。

该慈善机构表示,最具说服力的图像甚至连训练有素的分析师都很难将其与照片区分开来,并警告说,文字转图像技术只会越来越好,这将使警察和其他执法部门更难保护儿童。

一些图片描绘了真实的孩子,他们的脸和身体被用来训练人工智能模型,慈善机构决定不透露这些模型的名字。

在其他情况下,这些模特被用来根据他们上传到网上的全裸照片“裸体”儿童。

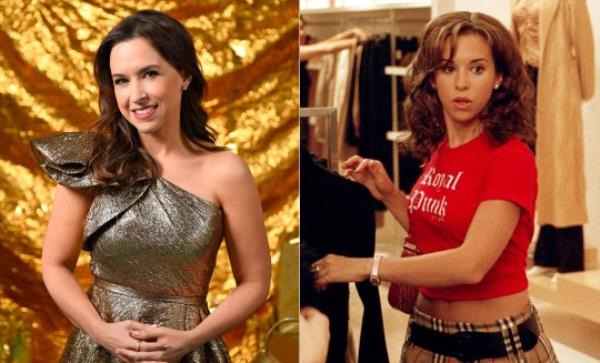

犯罪分子还利用这项技术制作名人的“去年龄化”照片,把他们描绘成性虐待场景中的儿童。

“这种威胁就在此时此地”

英国国家警察局长委员会负责儿童保护的伊恩·克里奇利(Ian Critchley)说,在网上产生这样的照片,使现实世界中的虐待儿童行为正常化。

他说:“很明显,这不再是一个新出现的威胁,它就在这里。”

“我们看到孩子们被精心打扮,我们看到犯罪者按照自己的要求制作自己的图像,我们看到人工智能图像的生产是为了商业利益——所有这些都使强奸和虐待真正的儿童正常化。”

我们可以做些什么场吗?

英国即将出台的网络安全法案旨在让社交媒体平台对其平台上发布的内容承担更多责任。

但这并不适用于人工智能公司,它们的模型正在被修改,并被用来生成滥用图像。

英国政府将于下周主办一场人工智能安全峰会,旨在解决与人工智能相关的风险,并考虑需要采取哪些行动。

IWF首席执行官苏茜·哈格里夫斯(Susie Hargreaves)表示,欧盟关于儿童性虐待的新法律应涵盖未知图像。

她说:“我们看到犯罪分子故意用已经遭受虐待的真实受害者的图像来训练他们的人工智能。”

“过去被强奸的儿童现在被纳入新的场景,因为有人在某个地方想看到它。”

政客们“玩忽职守”

智库Demos数字研究中心负责人艾伦?贾德森(Ellen Judson)表示:“随着生成式人工智能继续从根本上改变网络危害的性质,政策制定者又一次在方向盘上睡着了。”

她呼吁政府在理解和监管人工智能工具方面“走在前面”,特别是在它们的设计和开发方面。

她补充说:“等待下一次危机发生后再作出反应,这根本不是一种可持续的做法。”

英国内政部发言人表示:“网络儿童性侵是我们这个时代面临的主要挑战之一,人工智能生成的儿童性侵材料的增加令人深感担忧。”

“我们正在与包括互联网观察基金会在内的全球合作伙伴一起解决这个问题。

“上个月,内政大臣宣布了一项与美国政府的联合承诺,共同努力创新和探索新的解决方案,以打击这种令人作呕的图像的传播。”

点击分享到