当你想到与生成式人工智能(AI)相关的语言模型时,你首先想到的可能是大型语言模型(LLM)。这些法学硕士支持最流行的聊天机器人,如ChatGPT, Bard和Copilot。然而,微软的新语言模型表明,小型语言模型(slm)在生成式人工智能领域也有很大的前景。

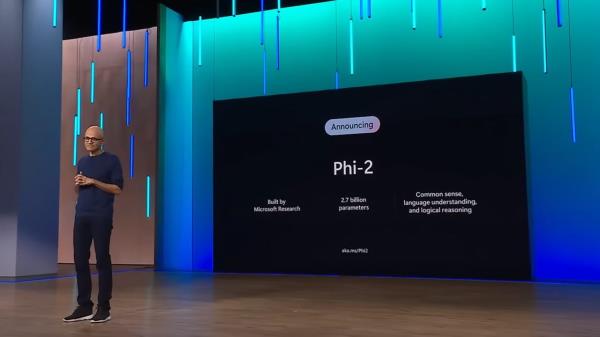

周三,微软发布了Phi-2,这是一个能够进行常识性推理和语言理解的小型语言模型,现在可以在Azure AI Studio模型目录中使用。

不过,不要被“小”这个词骗了。pi -2在其模型中包含27亿个参数,这比pi - 15的13亿个参数有了很大的飞跃。

微软表示,尽管外形紧凑,Phi-2在参数不足130亿的语言模型中表现出了“最先进的性能”,在复杂的基准测试中,它的表现甚至超过了比它大25倍的模型。

在几个不同的基准测试中,Phi-2的表现优于其他模型,包括meta的羊驼-2、Mistral,甚至谷歌的Gemini Nano 2,这是谷歌最强大的LLM Gemini的最小版本。

Phi-2的性能结果与微软对Phi的目标一致,即开发一个具有紧急功能和性能的SLM,可以与更大规模的模型相媲美。

微软表示:“一个问题是,这种突发能力能否在更小的范围内通过战略选择来实现,比如数据选择。”

“我们对Phi模型的研究旨在通过训练slm来回答这个问题,这些slm的性能与更大规模的模型相当(但仍远未达到前沿模型)。”

在训练Phi-2时,微软对使用的数据非常挑剔。该公司首先使用了所谓的“教科书质量”数据。然后,微软通过添加精心挑选的网络数据来增强语言模型数据库,这些数据经过了教育价值和内容质量的过滤。

那么,微软为什么要关注slm呢?

slm是llm的一种经济有效的替代方案。较小的模型在用于任务时也很有用,这些任务要求不够高,不需要LLM的能力。

此外,运行slm所需的计算能力远低于llm。这种降低的需求意味着用户不必投资昂贵的gpu来满足他们的数据处理需求。

点击分享到